文 | HW君

本文为B站【V3】期的视频讲稿。

有较多的动态演示,请以视频画面为主:

VR瞳距有什么用?为何到PICO 4才算是合格的VR视频机【双目VR摄影#V3】

0. 前言

近来一些VR设备在发布时,会宣传无极瞳距调节的功能,但很多人并不理解VR瞳距到底有什么作用。

而对于「双目VR摄影」来说,「瞳距」是一个非常重要的概念。

可以说,正因为采用了「Pancake光学」+「无极瞳距」,PICO 4才成为了一款能摸到「双目VR摄影」门槛的VR显示器。

而此前Pico Neo 3的「菲涅尔光学」+「三段瞳距」,则是完全不够格的。

因此PICO 4的发布在我看来是划时代的,很多人并没有意识到这一点。

从PICO 4开始,严肃的双目VR摄影作品才有了观看的硬件基础,我在这里讨论双目VR摄影理论也才成为了可能。

消失的模因,大家好,我是HW君。

欢迎来到【V3】期,也就是「双目VR摄影」系列的第3期。

【V系列】狭义上讨论的话题是,如何拍摄与制作「VR影像」。

广义上探讨的则是「摄影」「光学」「VR」这三个学科的交叉地带。

那在进入正题之前,还是要先说一个事情。

虽然PICO 4的出现为「双目VR摄影」提供了硬件基础,但我们仍然缺乏一个「双目VR影像」的分享平台。

前段时间PICO有在推「用户上传全景视频」的功能,我参加了这个活动,不过和我想象的不太一样。

首先我需要去「抖音」上传全景视频,然后进入「PICO视频」主控室右侧的「抖音」入口,找到全景板块。

而这个入口是没有搜索功能的,因此如果我想看到自己上传的视频,那就只能不停随机刷,运气好也许哪一天就能刷到自己的视频了。

并且,虽然抖音的后台支持上传双目3D格式,但是在「PICO视频」的这个「抖音」全景板块里,目前它的显示只有2D的。

也就是哪怕你上传的原视频是双目3D的,它也只会取左眼画面进行2D显示,而这就完全失去用VR观看的意义。

因此目前这个功能对我来说是不可用的,至少截止到我准备这期视频的时间点是这样的。

而这一期视频在梳理「瞳距」概念时,最好是能结合双目VR影像进行理解。

你在B站的2D视频里听我干讲原理,其实是非常枯燥乏味的。

但用于演示原理的双目VR视频则是很有趣的,并且很直观,而这种直观只能在VR设备的3D显示中去感受。

那PICO的用户上传视频功能还完全不能用,不过我也不打算再等了,所以还是先用百度网盘分享。

但是用网盘的话,又有另外一个问题。

PICO的本地播放器有亮度上的bug,默认亮度偏暗,会导致画面在观感上,晴天变阴天,正午变傍晚。

因此每次播放本地视频时,都需要在设置里找到亮度选项,任意拖动一次,再复位一下,这样才能得到一个正常的标准亮度。

很多人可能没有意识到这一点,因为他们看的VR视频并不是他们自己拍的。

而我是自己拍的视频,现场真实的亮度是怎么样的我很清楚,亮度偏暗对画面的影响非常严重,特别是室外自然场景,这种亮度异常是无法忍受的。

那这个bug我也跟PICO提交了,也不知道什么时候才会修好。

现阶段各位如果下载样片在本地观看的话,记得先操作一下。

那其实我也能理解为什么PICO不重视这些东西,因为「双目VR摄影」目前还太小众。

但我是看好这个方向的,它不是空中楼阁,而是已经实实在在可以被摸到的未来。

好了,前言就到这里,我们这一期聊一聊瞳距。

1. 四种不同的瞳距

首先我们需要清理一下概念。

现阶段人们提到「瞳距」时,有可能在指代4种不同的事物。

这里将其拆分为4个细项,分别是:

目瞳距、镜瞳距、实摄距、虚摄距。

以上这4个在不同场合下都可以称为瞳距,但实际上它们是不同的事物。

首先是「目瞳距」,也就是最基础的概念,通常讲「瞳距」不做说明指的就是「目瞳距」。

一般定义为,人眼目视正前方无穷远时,左右眼瞳孔的距离。

而「镜瞳距」则是指VR设备中,两个VR透镜的光学中心之间的距离。

像PICO 4的电动瞳距调节,调节的就是VR眼镜的「镜瞳距」。

最新的PICO 4 Pro宣传的自动瞳距调节功能,就是先用眼动摄像头去测量佩戴者的「目瞳距」,然后调节VR眼镜的「镜瞳距」以匹配「目瞳距」。

在双目相机里我们也常常会提到「瞳距」,它指的是两个平行镜头的光轴之间的距离。

像佳能RF 5.2mm双鱼眼镜头是60mm,PICO直播用的西顾FM系列双目相机则是65mm。

为了和前面的「目瞳距」和「镜瞳距」概念做区分,这里我们称其为「摄距」。

更进一步,我们将这种「实体相机」的摄距称为「实摄距」。

因为还存在另一个「虚拟」的摄距,指的是播放VR影像时,VR虚拟球幕中的虚拟摄像机的相对偏移量,可以称为「虚摄距。」

PICO的本地播放器有个调节选项叫「3D眼距」,它就是「虚摄距」。

「虚摄距」是一个相对的概念,通常情况下是不用去管的。

这里先不展开,容易造成混乱,暂时只要知道它和其他3种「瞳距」是不同的概念就行。

1.1 摄距与瞳距的匹配

所以在讨论「瞳距」时,我们要先确定是哪个瞳距。

理想情况下,这4种是要一致的,全部都统一匹配到观看者的「目瞳距」。

但现实总不是那么理想。

像Pico 3只有3档「镜瞳距」,分别是58、63.5、69。

如果A君的目瞳距是65mm,那无论他用63.5还是69的档位,其实都是不匹配的。

在不匹配的情况下,眼睛和镜片的光轴不在一条直线上,就可能会导致

(1)成像模糊

(2)画面扭曲

(3)深度感知异常

等这几种问题。

PICO 4则可以看做是有29档细分的「镜瞳距」,因此可以更好地匹配多种「目瞳距」,从硬件上避免因瞳距不匹配导致的成像问题。

VR眼镜的「镜瞳距」可以比较容易地进行调整,但是「摄距」却很难做到。

像佳能RF 5.2mm双鱼眼镜头的「摄距」是60mm,西顾FM系列相机的「摄距」是65mm,这两台机器的摄距是固定的,但它们拍出来的视频是要给「目瞳距」不同的人观看的。

因此如果B君的「目瞳距」是63mm,那他无论看佳能60mm拍的还是西顾65mm拍的双目VR视频,就都不是完美匹配的。

前面讲了,VR眼镜的「镜瞳距」和人眼「目瞳距」不匹配,会造成

(1)成像模糊

(2)画面扭曲

(3)深度感知异常

而双目相机的「摄距」和人眼的「瞳距」不匹配,其实并不会造成1「成像模糊」和2「画面扭曲」,而只会造成3「深度感知异常」。

这种「深度感知异常」的体验非常微妙。

你可以想象自己整个人被等比例放大或缩小,然后观察这个世界的体验。

假设你的瞳距是65mm,然后使用2倍的130mm摄距的双目相机拍摄VR180的视频。

那么后期观看时,你会感觉自己变成了一个等比例放大2倍的巨人,或者也可以等价于,整个世界除了你之外都缩小为原来的二分之一。

假设你的瞳距是65mm,而摄距是只有一半的32.5mm,那么在观看时,你会觉得自己变成了等比例缩小到原来二分之一的小人,或者整个世界除了你之外都放大到原来的2倍。

这种感觉真的非常奇妙,画面仍然是非常真实的,但所有透视关系都变了。

这种「深度感知异常」只有在3D的VR眼镜里才能体验到。

为了直观地展示这种奇妙的体验,我用2个GoPro拼了一套双目相机。

它可以很方便地调节「摄距」的大小,最小为36mm,最大则理论上可以为无穷大。

然后我用36、65、130、325、650,1950的摄距分别拍了一些样片。

其大致上对应于65mm瞳距的人,等比例缩放为约0.5倍、1倍、2倍、5倍、10倍,30倍之后,观看世界时的感受。

大家可以下载样片在VR设备里观看,体验一下自己「小人化」或者「巨人化」之后,观看这个世界的感觉。

像650mm摄距,大概是正常人等比例放大10倍,那这个体型其实接近于一台高达。

那么可以这么讲,如果你变成了高达,那你俯瞰这个世界时就是这种体验。

而奥特曼的身高是大概是人类的30倍,像迪迦的身高是53米。

因此用30倍的1950mm摄距拍摄的画面,差不多就是你变成奥特曼之后,双眼看到这个世界的感觉。

这些观感非常有趣,单目2D是看不出区别的,只有在VR的双目3D显示中,才能感受到深度信息的差异。

其实我还有很多可以整活的创意,等PICO把3D内容的分享和检索功能做出来,再给大家一一展示。

2. 测量基线的改变

我们在【V1】期里讲「双目汇聚」时说过:

瞳距是人类测量「深度信息」的「基线」,我们以此为基准去丈量世界。

虽然「瞳距」会随着年龄出现一定的变化,但这种生理变化是非常缓慢的,我们完全可以将其视为是固定不变的。

但VR设备可以在一瞬间改变这个事情。

当我们戴上VR眼镜观看不同「摄距」的VR180视频,那么一瞬间你的「目瞳距」就突变成了「摄距」。

你的眼睛直接连接到了相机镜头上,你变成了巨人或者小人,看待世界时的感受也不一样了。

这个过程也就是「测量基线」出现变化,因此基于双目对于深度信息的感知也出现了变化。

但这种因为「摄距」和「瞳距」不匹配导致的「深度感知异常」。

虽然很新奇,但其实也是很怪异的。

而我追求的是在「VR影像」里,将我看到的画面,准确无误地传递给你,希望你能「见我所见,感我所感」。

因此我追求的其实是,还原一个真实的世界。

但人和人的瞳距并不相同,通常非洲人最宽,亚洲人次之,欧洲人最窄。

并且一般男性要比女性的瞳距更宽。

如果要追求还原真实,那么所有感觉都需要和现实一致。

而同一摄距所拍的VR影像在不同瞳距的人看来,其实观感是不太一致的。

同样是65mm摄距拍的视频,60mm瞳距的人觉得画面偏小,70的人觉得画面偏大。

当「摄距」小于「瞳距」,那画面观感是人物体型偏大,这其实是会引起人的警觉性的。

所有动物天生都会警惕比自己体型大的动物,因为自己可能打不过对方,会有危险。

而「摄距」大于「瞳距」则会好一点,不会引起这种警惕感。

我们只是会觉得VR眼镜里的那个人看上去小小只的,很迷你。

我自己的瞳距是68mm,所以我自己DIY双目相机拍摄时,都会做成68mm的摄距,这样拍摄出来的VR影像对于我本人来说是最自然的。

而我看65mm摄距的影像,近距离时是能够感觉到异常的,人物体型会偏大。

如果看的是佳能双鱼眼镜头60mm摄距的画面,这种异常感就会变得非常明显,近处的人物体型大了10%左右,根本没有办法忽略这种异常感。

摄距太小的话,原本小鸟依人的妹子变得高大威猛,这是非常出戏的。

但摄距太大的话,画面里的人物看起来偏扁,甚至有点不聪明的样子。

因此长远来说,如果真的想要追求「真实」的双目VR影像,那么以后可能会有「可变摄距」的双目相机出现。

而人们在观看双目VR影像时,可能会倾向于选择与自己瞳距相近的摄距档位拍的影片。

而像PICO能拿到用户的瞳距数据,反过来也可以参与定制双目相机的摄距。

这些数据最好是能公开,这样摄影师们可以根据自己的目标人群和创作思路,选择不同的摄距进行创作。

而更进一步,如果要达成一种更大的通用性,那么理论上在部分场景中,可以利用「虚摄距」进行某种自动的补偿。

像我的「目瞳距」是68mm,如果VR影片的「实摄距」是65mm,那么系统可以自动补偿一个「虚摄距」,在尽量不破坏画面的情况下,去还原最真实的观感。

这就类似iPhone的「原彩显示」功能。

iPhone如果开了「原彩显示」,就会根据环境色温去自动补偿屏幕的颜色,从而让屏幕色彩可以在任意环境色温下都接近人眼感知的真实。

所以说我会期待苹果下场做VR眼镜,因为这些涉及「显示标准化」的东西,苹果的工程师是一定会考虑的。

当然「虚摄距」的这种补偿只能做部分场景的细微调整,例如补偿近处物体的深度感知。

因为改变它会让虚拟摄像机偏离虚拟球幕的球心,这其实会破坏整个画面的投影关系和深度信息。

并且有些时候我们也会为了视频创意而特意用很夸张的摄距,例如用650mm的摄距让你体验变成高达的感觉。

而如果拍摄的主体景物都比较远,那么其实也是没有必要进行调整的。

当然,这些问题离我们非常遥远,现阶段的双目VR摄影的问题还有很多,远远轮不到要考虑这个的地步。

只是说如果我们追求的目标,是让VR影像还原真实的世界,那么就总有一天会碰到它。

3. 观看VR180的方式

很多人在讲VR视频的时候,常常提到「可以转动自己的头部」。

但这一说法对于3D的VR180视频来说其实是不正确的。

我们假设在VR180视频中,正前方为0°,最左端为-90°,最右端为+90°。

那么正确的观看方式其实是,保持头部正对着0°位置不动,然后眼球转动观看四周。

此时我们获取到的深度信息就是正确的。

当然受限于现阶段VR设备的视场角,正对着0°的话还有很多区域看不到,为了看到这部分就不得不转动头部。

那么在转动头部的时候,也要尽量保持较小的头部转动,而让眼球承担更多的转动。

因为我们前期在拍摄VR180视频时,双目相机是固定不变的,它获取的是基线(摄距)正对着0°位置时的深度信息。

所以在观看时,我们也需要保持人眼的基线(目瞳距)正对着0°位置,才能还原真实的深度信息。

对于水平放置的距离为摄距的两个鱼眼摄像头来说,正对着的0°位置图像的成像,是有水平视差的。

而对于90°位置的图像来说,鱼眼镜头相对位置其实是一前一后,成像并不能得到「水平视差」。

而因为90°位置的图像没有「水平视差」,那么「双目汇聚」和「双目视差」机制也都失效了。

所以当我们在VR180视频里将头部从0°转动到90°位置时,基于双目的深度信息会丢失,图像就变成2D的。

于是「单眼聚焦」和「大脑补充」会出来接管我们的深度感知,你会察觉到画面的怪异。

当然这个过程不是突变的,而是从0°到90°慢慢变化的。

所以观看VR180视频的正确方式是尽量让眼球转动,并减少头部转动。

因此我们在【V2】期里强调,在有限资源下,可以尽量使用接近「正交投影」的鱼眼镜头,来保证VR180影像的中央画质。

因为哪怕±90°位置的画质再清晰,此处的深度信息也一定是丢失的,双目画面出现失真,小姐姐变成巨人,观感大打折扣。

所以在VR180影像里,有时候我们可以忽略鸡肋的边缘画质,确保中央主体部分足够清晰和精彩就行。

3.1 节点距

可以更深入地去理解「瞳距」。

通常认为「瞳距」是指双眼看向正前方无穷远时,左右两个瞳孔之间的距离,也因此才这样命名。

但实际上这个说法并不精确。

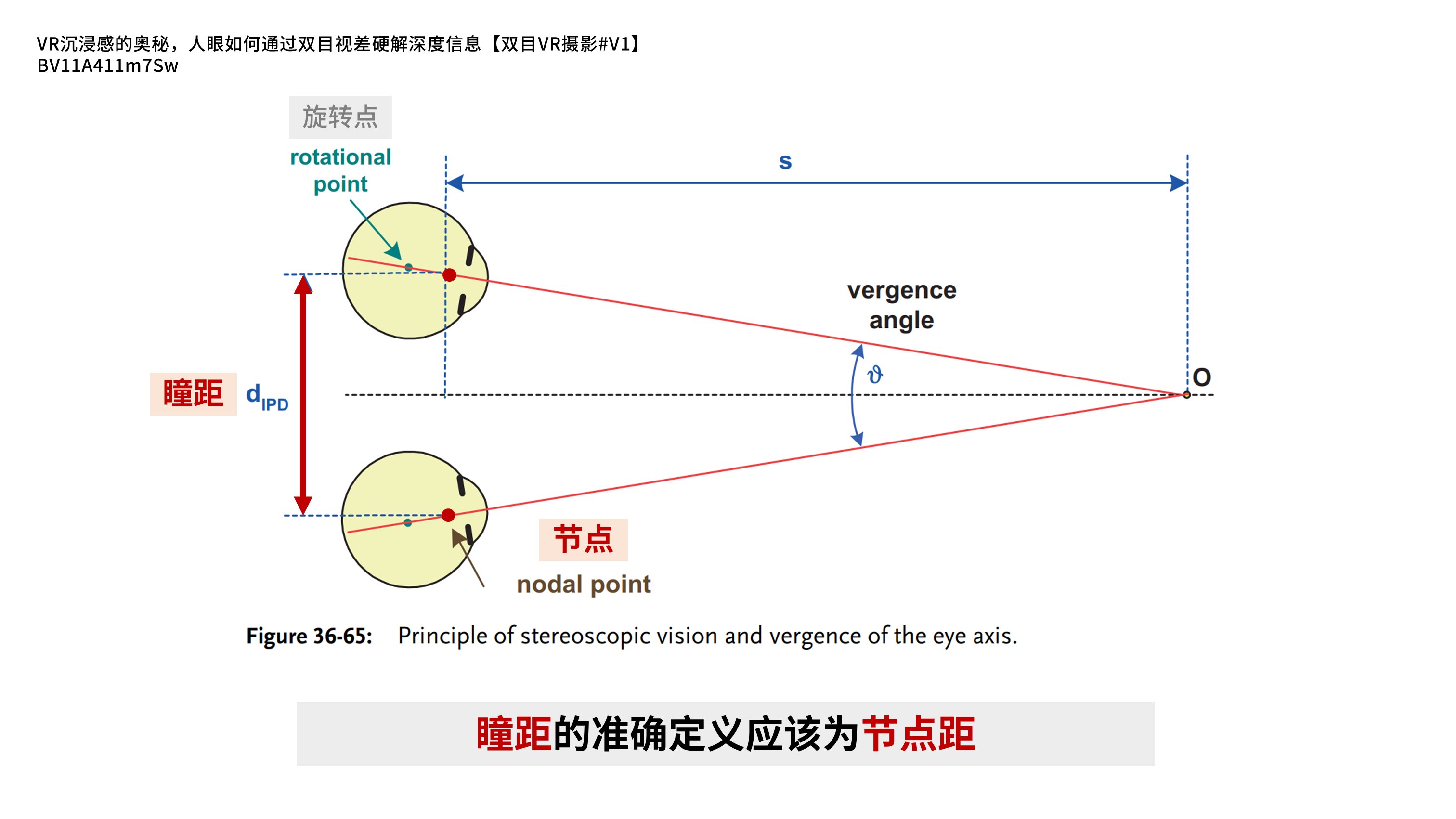

我们在【V1】期讲「双目汇聚」时,提到汇聚的主体是「视轴」。

而「视轴」是过「注视点-节点-中央凹」的轴线。

在Wiley出版社的《光学系统手册》第4卷的这张36-65的图里,可以看到它对于瞳距的定义是,两个眼球「节点」之间的距离。

因此「瞳距」的更精确的定义应该是「节点距」,也就是左右眼球「节点」之间的距离。

如果我们把眼球当作一个光学透镜,那么「节点」就是这个镜头的光学中心,穿过「节点」的光线不会发生折射。

「节点」也可以叫做镜头的「无视差点」或者「最小视差点」。

因为绕这个点旋转的话,所拍的照片可以拼成一个完整的没有视差的球面。

在传统2D全景摄影里,就需要把镜头的「节点」放在全景云台的旋转球心,绕「节点」旋转来拍摄多张照片,后期拼合成一个360°球型的全景图片。

我们可以做这样的一个实验。

将两只手指放在正前方,A近B远,大概在距离人眼20cm和40cm的位置。

然后闭上左眼,只用右眼。

调整手指的位置,让近处的手指A完全遮挡住远处的手指B。

此时保持头部不动的情况下转动眼球,无论是上下转动,还是左右转动,A和B的遮挡关系都是不变的,也就是此时眼球的转动不会带来视差。

继续保持这个姿势,此时如果我们转动头部,在一定角度之后,就会发现原先被A遮挡住的手指B会显露出来。

这意味着此时头部的转动轴没有在「节点」上,这个转动导致画面出现了视差,A和B的透视关系被破坏。

因此尽管在《光学系统手册》的这幅图中,眼球的「节点」和「旋转点」并不一致。

但是实际上人类眼睛的转动,完全可以看做是绕眼球的「节点」转动,至少我们的实验结果是如此。

为什么我们日常测「瞳距」时,强调双眼要看向正前方的无穷远?

这是因为眼球在转动时,瞳孔的位置实际上是会发生改变的。

因此测得的瞳孔间距也会发生改变,这个距离在看向无穷远时最大,在做斗鸡眼时最小。

所以「瞳距」更准确的定义应该用「节点距」,它和双瞳看向无穷远时的间距是相同的。

并且因为眼球绕「节点」旋转,无论如何转动看向何处,「节点距」都不会发生改变。

而这种生理结构是功能性的,因为「节点距」是人类丈量世界的基线,人类以此为基准去测量深度信息,所以这个基线就需要是固定的,不能变来变去。

有时我会看到有些朋友说,「3D摄影」中物体靠近之后,人眼视轴交叉呈斗鸡眼状,此时瞳距发生了改变,因此深度信息也发生了改变。

那这种说法是错误的,因为实际上真正的瞳距是「节点距」,它并不会随眼球的转动而发生改变。

而正因为眼球的转动是绕「节点」的,所以在观看VR180影像时,我们只要保持头部正对着0°的位置不动,那么眼球的「节点」就和相机鱼眼镜头的「节点」是重合的。

在转动眼球后,节点也还能保持不变,于是测量的基线不变,也不会出现其它视差,基于双目的深度信息也能保持正常,不会导致「深度感知异常」。

可以说,这个理论也是VR180视频能够还原现实观感的一个基础。

3.2 Pancake光学的意义

VR180的正确观看是尽量保证头部不要多余转动,而让眼球转动,这样深度信息才是正确的。

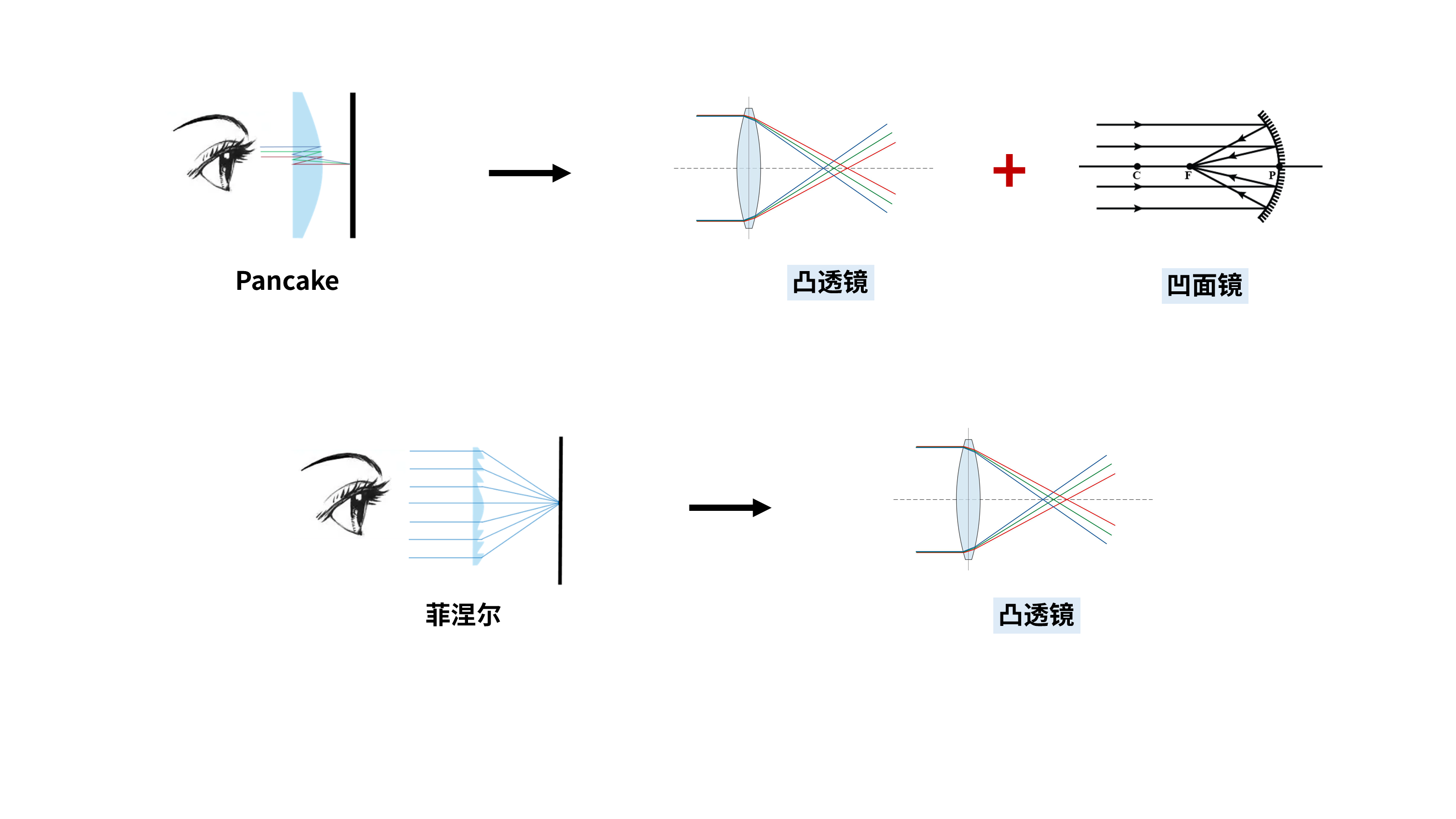

所以哪怕先不考虑最重要的色散问题,「Pancake光学」也要比「菲涅尔光学」更适合VR180影像的观看。

首先是「Pancake光学」的「清晰PPD区域」更大。

PICO 4的视场角是105°,可能大概有80°是能达到20 PPD的,清晰度非常均匀和平坦。

而采用「菲涅尔光学」的Pico 3视场角是90°,它中央的20°圆区域非常锐利,中心区域的PPD一定是超过20的。

可是一旦出了中央20°圆的区域之后,清晰度就下降得非常快,会变得非常糊。

因此使用Pico 3,最好的习惯是保持眼球不动直视中央,然后依靠头部来转动,这样可以得到最清晰的体验。

如果只是玩实时渲染的VR游戏,那倒没有什么问题。

但是VR180视频所要求的「头部不动、眼球转动」和「菲涅尔光学」的使用习惯是有冲突的,只有「Pancake光学」能够满足。

因此「Pancake光学」+「无极瞳距」的PICO 4才算是VR180影像的合格播放器。

而「菲涅尔光学」+「三段瞳距」的Pico 3是完全不够格的。

当然Pico 3更要命的问题是「色散」。

「Panceke光学」的折叠光路可以拆成「凸透镜成像」+「凹面镜成像」2个部分,其中的「凹面镜成像」是不会引入色散的,因此PICO 4整体的色散控制得非常好。

而「菲涅尔光学」就只是一个拍扁了的凸透镜,为了做大视场角,就必然会有更严重的色散。

因此Pico 3看起来就像10多年前那种老笔记本电脑用的45%NTSC色域的TN屏幕。

而PICO 4则更接近于100%sRGB色域的IPS屏幕。

当然,如果你只玩VR游戏,那么你大概率不会在意颜色上的问题。

但是在观看实拍的VR180图像时,就无法避免会发现整个画面都在发紫。

大家可以观察PICO主控室左下角的蓝色通知图标和紫色推荐图标。

在Pico 3里,只要稍微转动头部,就能观察到蓝色分量出现漂移,整个图标像是有动画效果一样。

实际上图标是静止的,这种漂移是菲涅尔的色散变化导致的。

而在PICO 4上就好了许多,只有在靠近镜片外边缘的位置会出现比较明显的色散。

有趣的是,很多人解读自己「所见为何物」的能力其实并不好。

我不止一次听到有人宣称,Pico 3的显示要比PICO 4要清晰,PICO 4的颗粒感严重。

实际上这种错觉并不是来源于Pico 3更清晰,而是因为Pico 3的透镜色散太严重,导致颗粒感被色散给模糊掉了而已。

而PICO 4因为光学效果更好,于是像素点会更加清晰,更加颗粒分明。

这种问题在玩VR游戏时,其实是看不出来的,因为VR游戏的丰富度很少能吃满20的PPD。

但只要看实拍的8K高码率的VR180视频,就会很容易发现这其中的区别。

当然VR设备本身的色散是一个因素,前期的双目相机所拍摄的片源色彩又是另外一个因素。

像PICO的VR直播用的西顾FM系列的相机,颜色还原就一塌糊涂。

因此PICO直播间的那些VR180直播片源,无论是用Pico 3还是PICO 4观看,它们的颜色都是非常违和的。

特别是到了白天户外的自然光线下,双目相机本身的颜色问题,会比VR设备的光学显示问题更严重。

不知道PICO有没有意识到这一点。

4. 标准化后才有真实

我相信大部分VR用户都是把VR设备当作「游戏机」的。

VR玩游戏的对于显示的需求,其实跟PC是差不多的,要求屏幕清晰艳丽,刷新率要高。

但是对于设计师群体来说,一块屏幕最重要的是,色域要标准,颜色还原要真实。

为什么设计师、摄影师、自媒体群体会喜欢用苹果的产品。

因为苹果的生态系统有一项独家的竞争力,那就是全平台统一的标准色彩管理。

苹果可以在iPhone、iPad、Mac上都做到统一、标准化的色彩管理,这是它的护城河。

只玩游戏的朋友没有办法理解为什么有人会花那么贵的价格,去买苹果那个只有60Hz刷新率的显示器。

因为只有标准化,才有通用的生产力,尤其是设计领域。

而到了VR里,要标准化的东西除了颜色,还有很多其他的东西。

所以我会纠结PICO本地播放器的亮度偏暗的问题,它的影响其实非常大。

但这些都是软件上的问题,至少PICO 4在硬件上是已经准备好了的。

从PICO 4开始,因为「pancake光学」和「无极瞳距」,VR设备的显示终于有了一块还算勉强能用的屏幕了。

也因此,VR设备终于可以跳出长久以来的「游戏机」的定义,进化一个可以进行严肃内容创作的「图像显示器」。

我在这里研究实拍的「双目VR摄影」也才成为了可能。

对于游戏玩家来说,Pico 3和PICO 4其实差别并不大,Pico 3还更便宜、续航更久。

但对于设计师来说,这是这块屏幕「能用」和「不能用」的区别。

而我想做的是,通过「VR影像」将我看到的画面,准确无误地传递给你,希望你能「见我所见,感我所感」。

我追求的其实是,在VR里还原一个真实的世界。

我需要的是影像的标准化。

那么在这个意义上,现在被炒得非常狂热的AIGC概念,也就是「人工智能生成内容」技术,对我来说是没有意义的。

我希望在实拍的VR影像中,现实世界的真实信息,可以被准确无误地记录、保存和传递。

哪怕要做风格化,也是基于真实存在的信息来做。

我不需要AI来帮我猜测并添加那些,现实中原本不存在的东西。

就像我的文章、我的视频稿子,都是我自己一字一句写的。

我不需要ChatGPT来帮我润色,因为我不想糊弄你们。

我想把自己的观点准确无误地传递给你们,你们作为观众直接与我本人对话。

这并不代表我不接受新事物,而是我认为还值得这样去做。

当然,这就说得有点远了。

我只是想表达,其实人们对于VR设备的需求是多样化的,

VR从业者的思路没有必要只局限于试图构建一个想象的「虚拟世界」。

在VR里,也是有还原真实的「现实世界」的需求的。

好了,那这一期就先到这里。

我是HW君,我们下期再见。

(本章节完)

By HW君 @ 2023-04-27

我瞳距70!难怪我不管是用pico3还是4u看180°视频都感觉人物特别大,尤其是欧美的视频,里面的妹子各个虎背熊腰,小日子拍的能稍微好一点,但是也能明显感觉人物偏大,我一直以为是pico和这些外国视频的兼容性问题,原来是我瞳距的问题。。。

感谢作者的分享,我有一个思考关于转动眼球还是转动头。在观看vr180视频的时候,左(或者右)眼播放的画面可以认为是通过放置在圆心的虚拟相机去看半圆上的画面,在软件中限制了虚拟相机只能根据头部转动而转动,而不平移,此时无论我们转动眼球,还是转头,其实改变的只是虚拟相机的朝向,二者应该不会有区别

(1)转动头部会改变虚拟相机的朝向;(2)转动眼睛并不改变虚拟相机的朝向

转动眼睛不会改变虚拟相机的位置是对的。我想表达的意思是,如果我们把虚拟相机看作眼球,那么虚拟相机的转动可以看作是眼球的转动。这样转头带动的虚拟相机的转动,模拟了转眼的过程。这是我认为转头跟眼睛转动的效果应该是一样的原因