文 | HW君

本文为B站【V11】期的视频讲稿。

存在动态演示,请以视频画面为准。

糟糕的VR180格式,如何改良球面3D影像格式【双目VR摄影#V11】

0. 标准的VR180

2017年6月,谷歌旗下的Youtube宣布支持一个叫VR180的视频格式。

同时谷歌的Daydream团队也和相机厂商合作推出了一些可以拍摄VR180视频的相机,有许多至今还在二手市场上流通着。

多年后回过头来看,VR180既是一个伟大的格式,也是一个糟糕的格式。

消失的模因,大家好,我是HW君。欢迎来到【V11】期,也就是「双目VR摄影」系列的第11期。

【V系列】狭义上讨论的话题是,如何拍摄与制作「VR影像」。广义上探讨的则是「摄影」「光学」「VR」这三个学科的交叉地带。

前面几期说到,人类在三维空间中依靠「深度」和「张角」来进行体积感知。

因此如果想要达成VR影像的「身临其境」,我们需要对其进行标准化。

现阶段能够较好实现这一点的影像形式,便是3D的VR180。

相机捕获半球空间的图像,然后VR眼镜复现出半球空间的图像。

只是因为相机传感器是平面的,所以中间需要做一步「球面到平面再到球面」的投影转换。

而一旦知道了在这个过程里,我们真正想要的是正确的双目深度和张角(FOV)之后,那么我们马上就会发现VR180,或者说双目3D的180°等距柱状投影,是一个非常低效的格式。

1. 低效的VR180

在上一期【V10】期里,我们分享过这样的一个VR180格式的视频。

《VR | #10 非标传统平面3D的困境,为何能标准化的球面3D才是未来》

http://gonememe.com/archives/7471

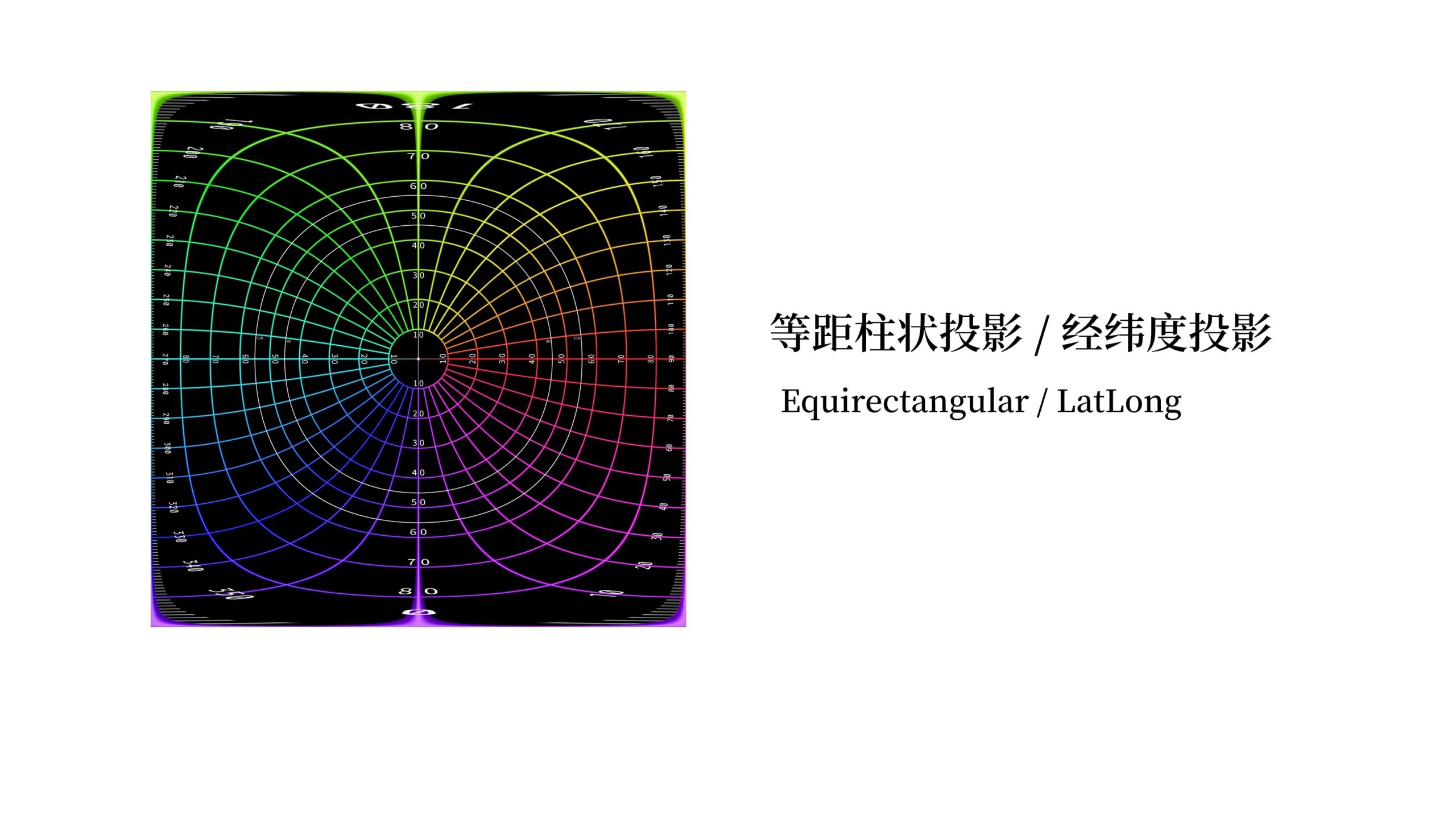

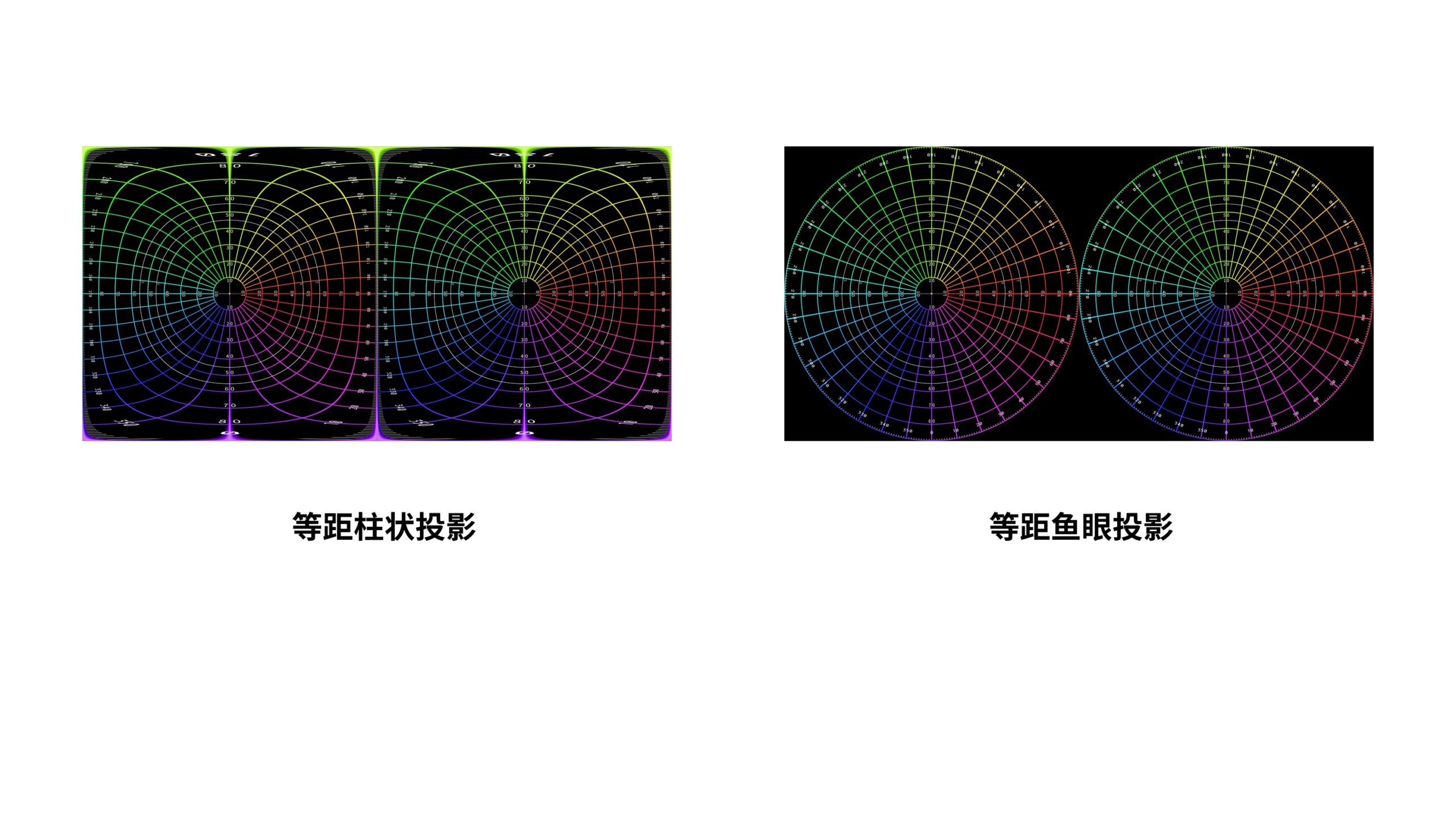

它用了「等距柱状投影」,并标明了FOV的等高线。

这其实就是VR180对FOV进行标准化的方式,所有图像在显示时,都会在空间中进行角度上的锁定。

但它使用的「等距柱状投影」其实是没有必要的,因为这原本是为360°球型图像而设计的投影。

我们在【V2】期的第4小节曾经提到过这一点。

《VR | #2 认识鱼眼镜头,球面的投影方式和鱼眼校正》

http://gonememe.com/archives/7268#4_VR180

把地球仪按照「等距柱状投影」展开,就可以得到一张2比1的矩形世界地图。

而VR180就是把180°的半球也按照这种形式展开,然后左眼右眼并列拼在一起。

播放器在播放VR180视频时,会重新投影回2个180°半球图像。

而在这个过程中会有非常多不必要的多余解算和像素浪费。

我们在【V6】期里其实就遇到了这一问题。

《VR | #6 自制VR180双目相机的思路》

http://gonememe.com/archives/7417

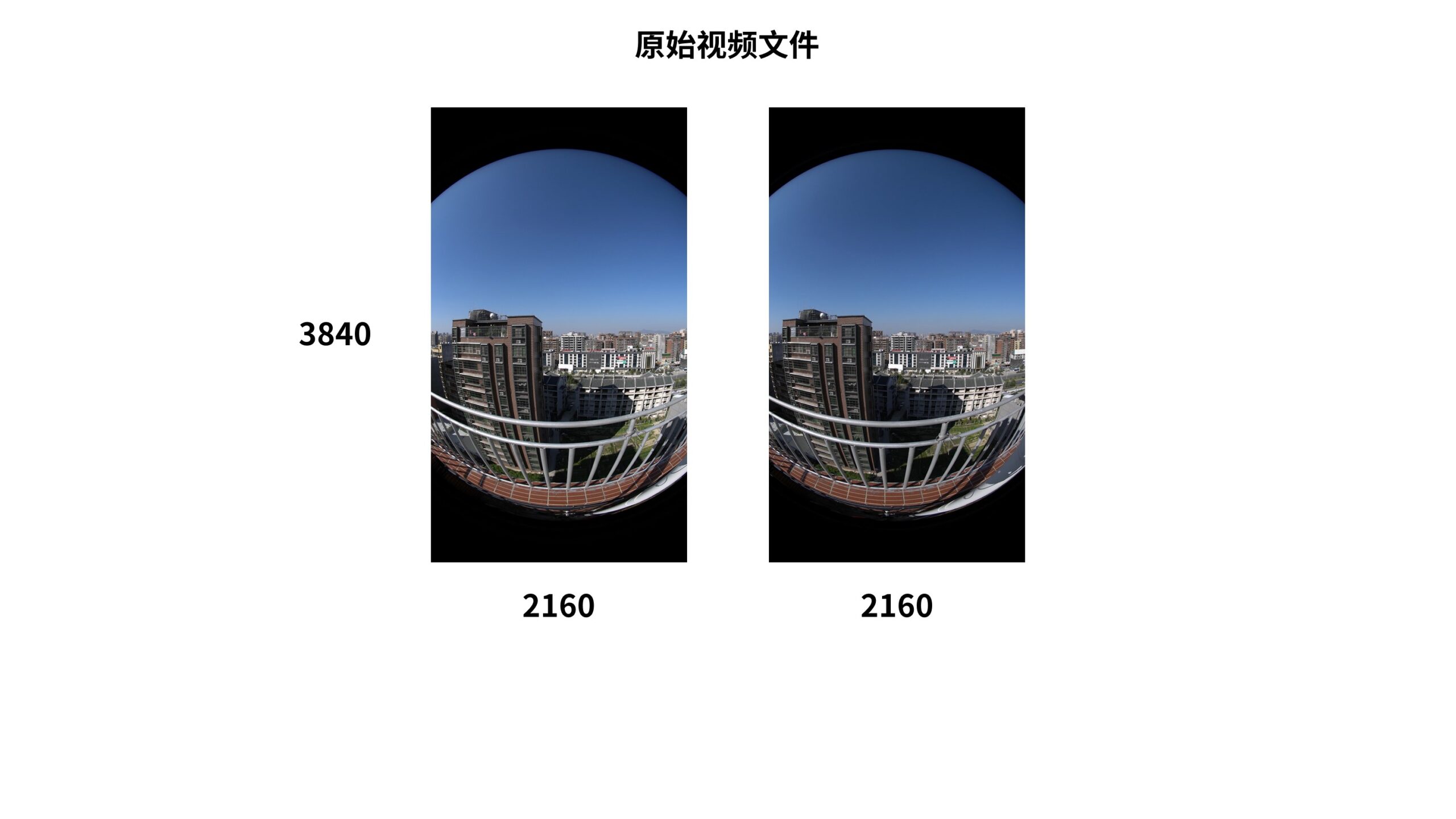

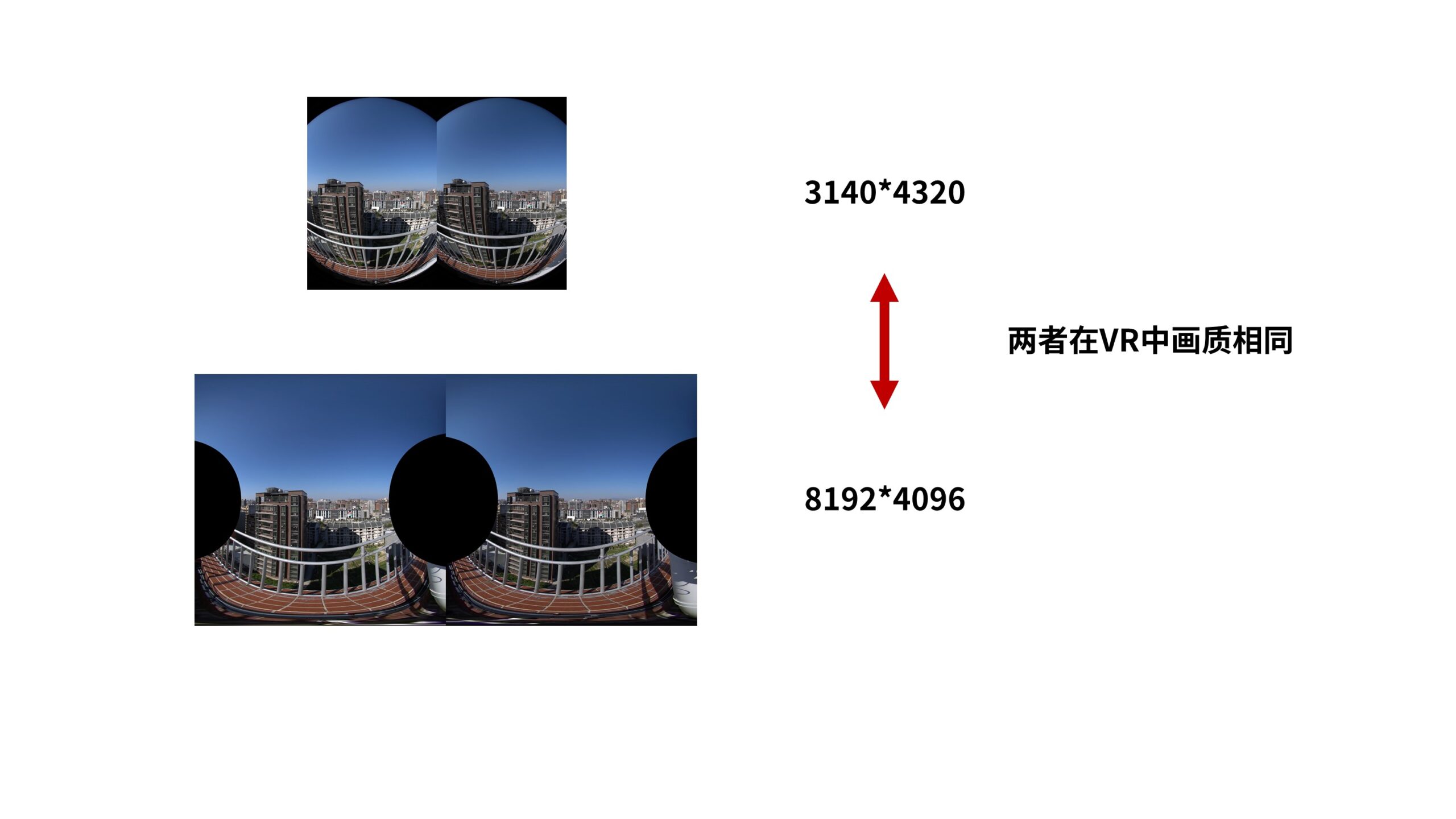

我自己用索尼A6400+美科6.5mm镜头DIY双目相机时,相机所拍摄到的是2个分辨率为3840*2160的4K视频。

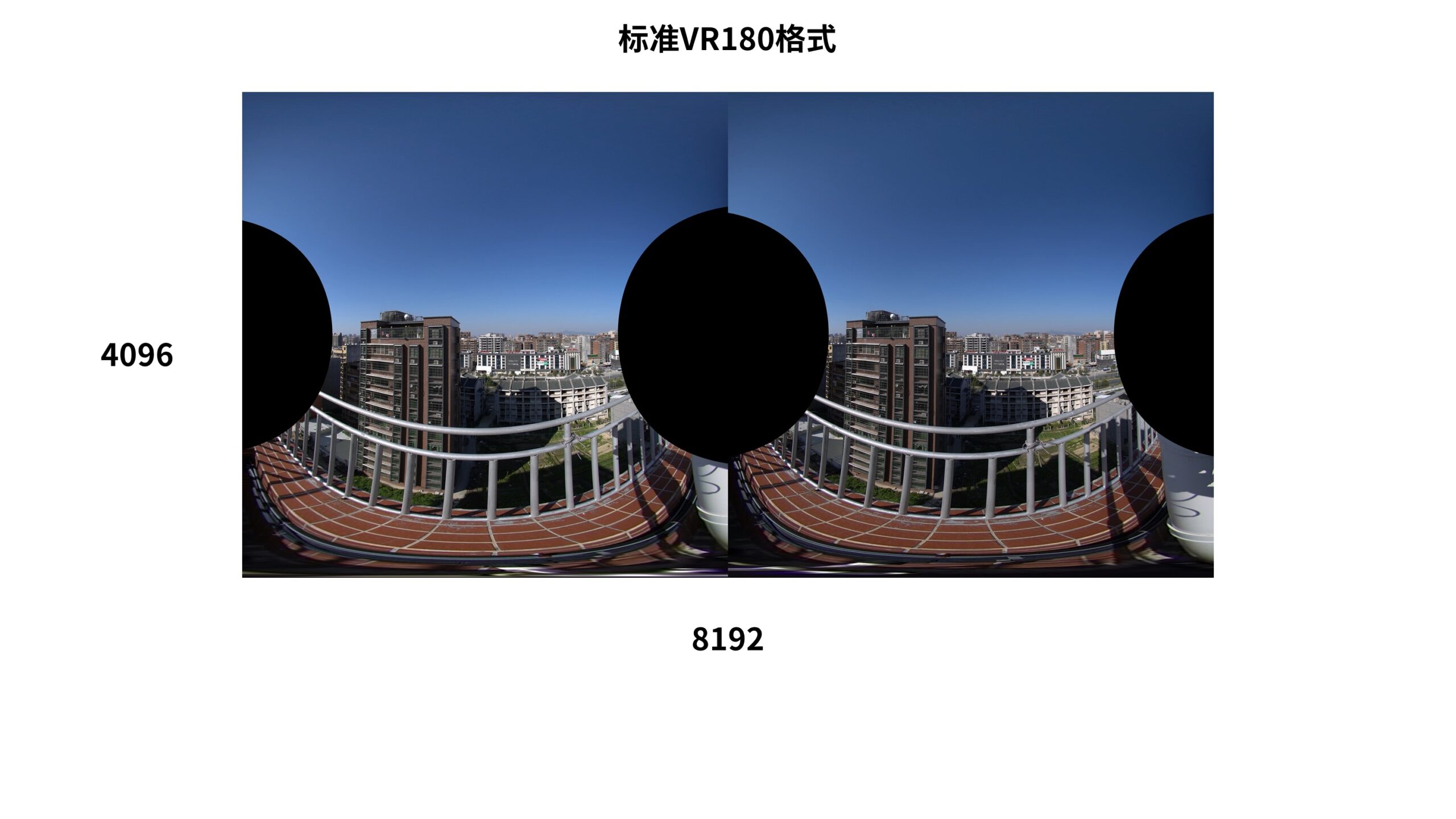

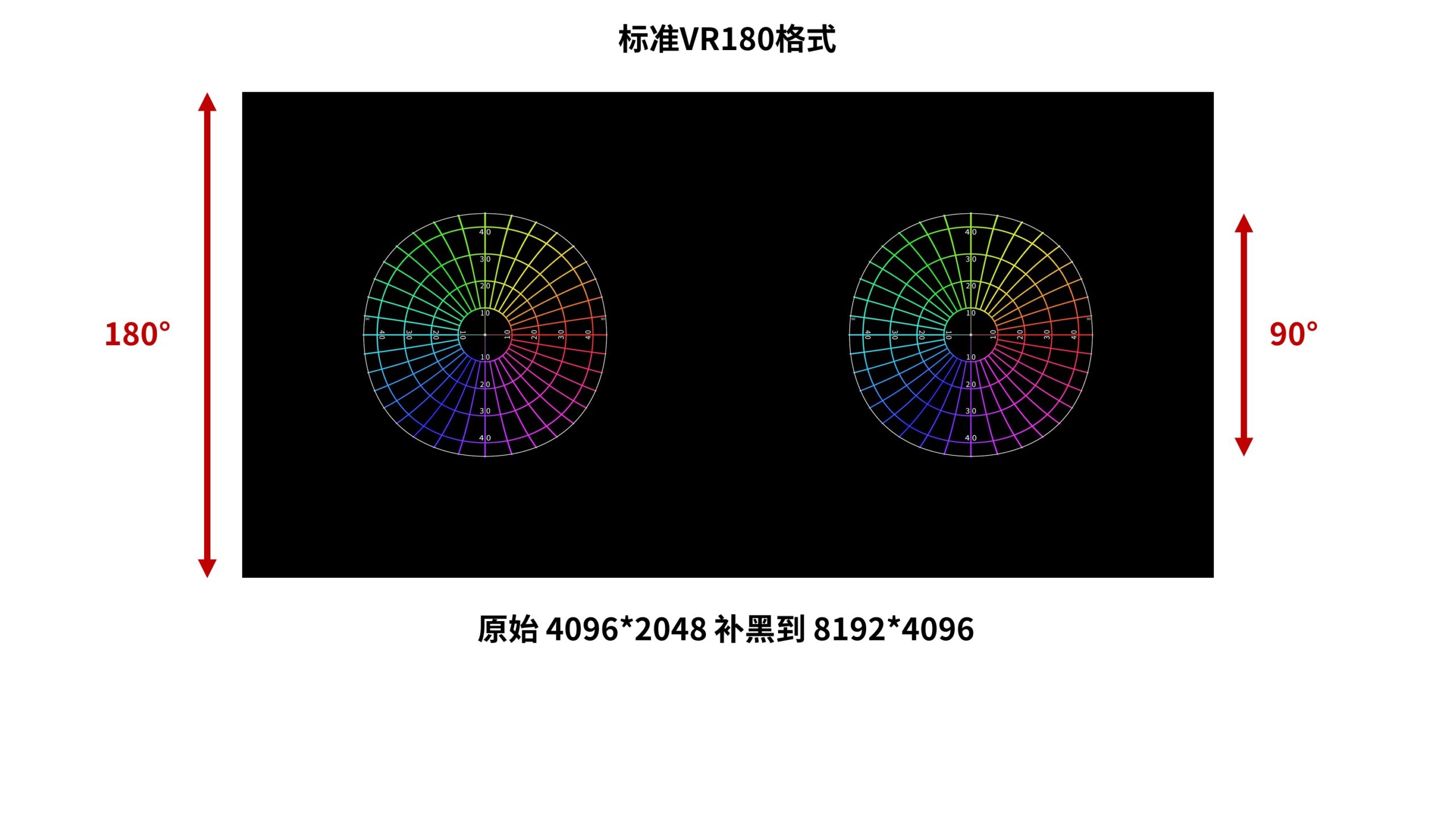

但为了保留最原始的画质,我需要将其展开解算到8192*4096的VR180格式。

如果不是展开到这么大的分辨率上,那么中央部分的画质会有所损失。

但这种展开其实是对算力和存储的巨大浪费。

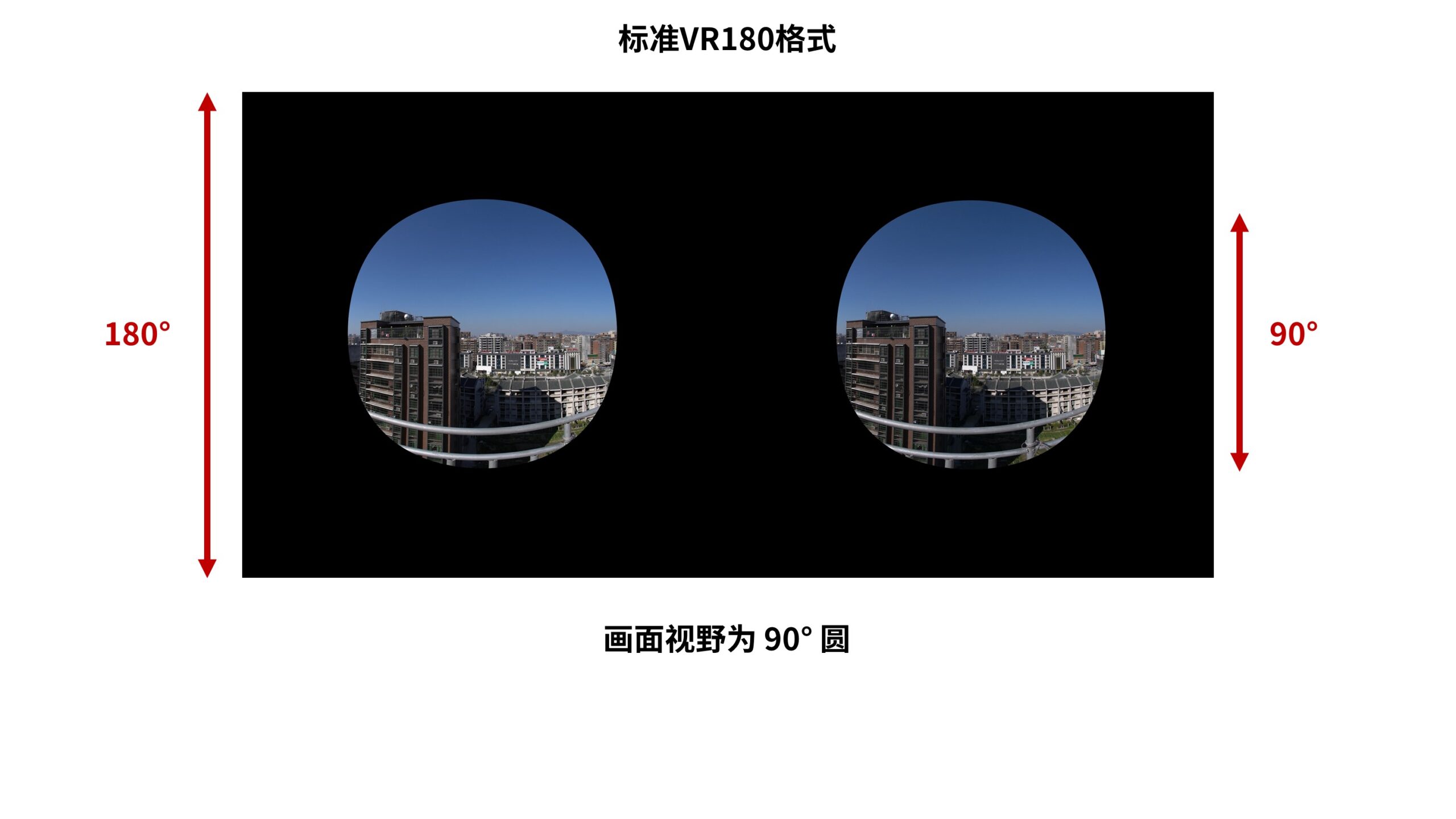

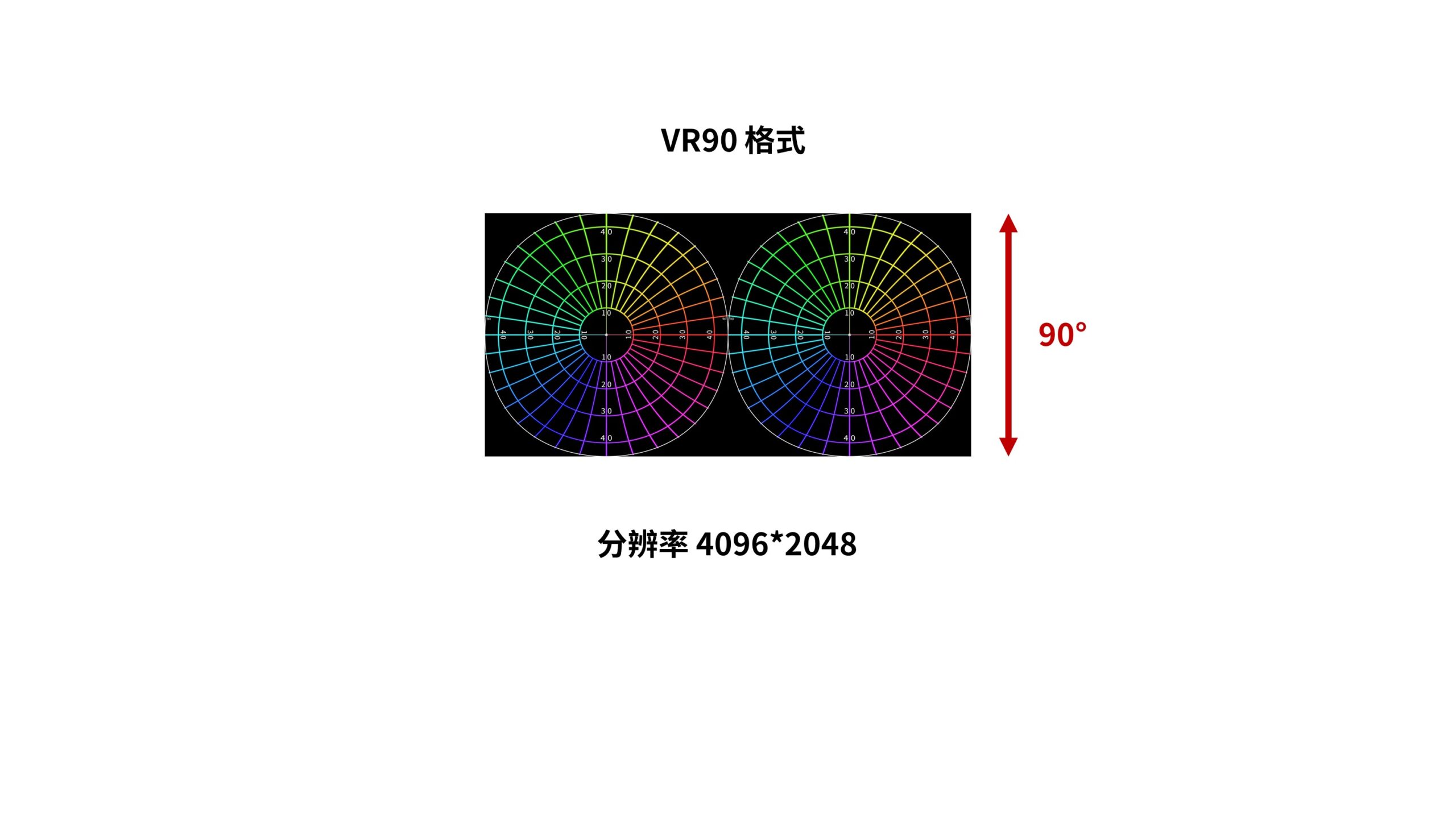

假设我拍了一对90°的图像,我们不妨称其为VR90。

如果我想要VR眼镜能够正常播放这个格式,那么我也需要在视频的外围补黑,补成VR180的标准格式,VR眼镜才能正常播放。

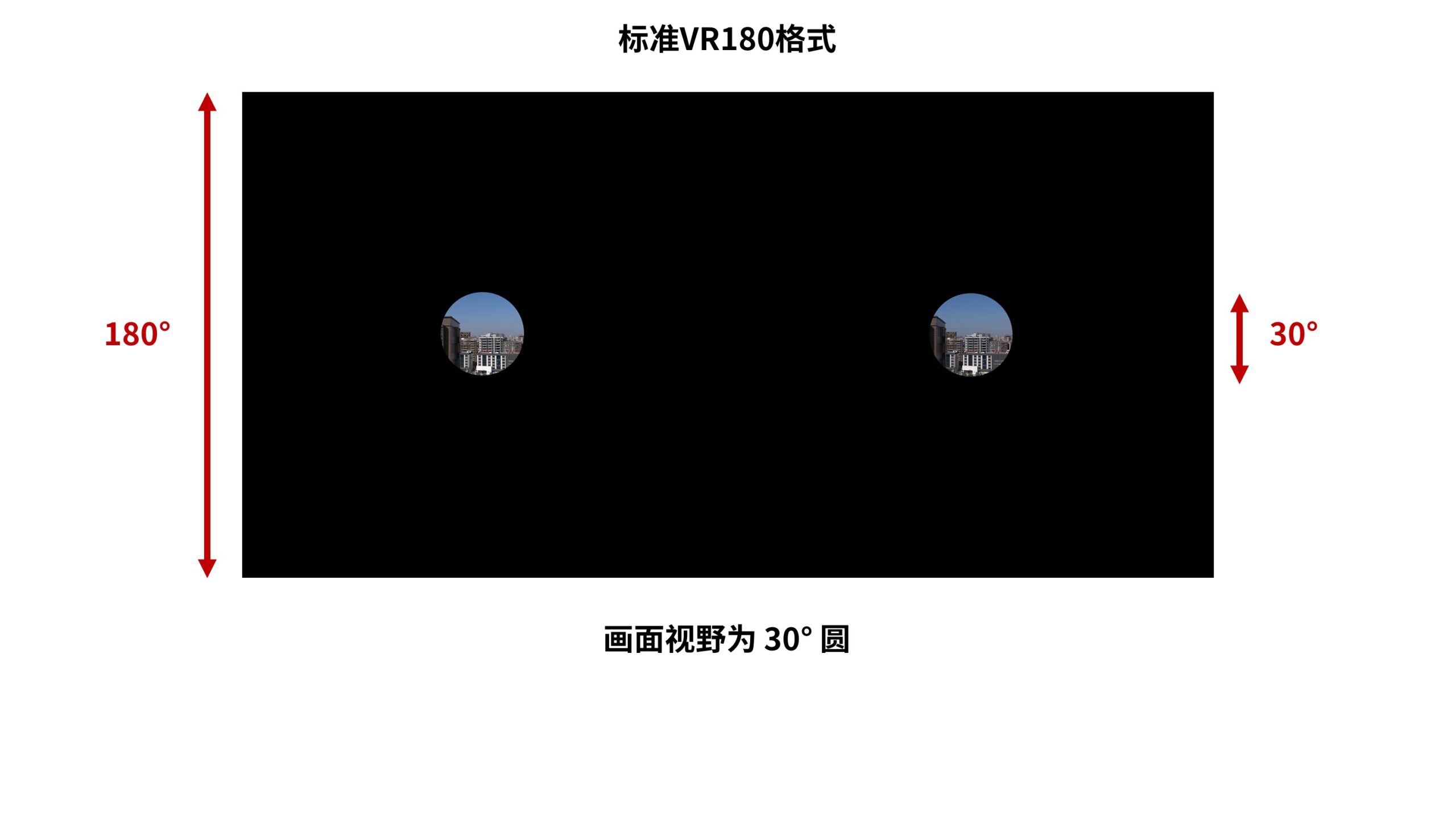

哪怕我只想拍30°的图像,也需要补150°的黑边到180°,才能正确播放,这个步骤是毫无意义的。

VR180格式的核心是把FOV标准化,那么凑满180°就是一个非必要的限制,一个思想上的牢笼。

我们完全可以在图像中嵌入一个数据,用于告诉播放器这个VR图像的FOV是多少。

也就是说我们可以按照VR180的形式,扩展出从VR1到VR360中间各种各样不同FOV的格式。

如果我想拍90°的画面,那制作成VR90就行。

而不是像现在这样只能补齐黑边凑满180°,把一个4K的视频补成毫无意义的8K视频。

这跟手机屏幕显示比例的逻辑是一样的,我们不必拘泥在一些思想的牢笼上。

2016年小米发布了MIX,在当时为了实现MIX超前的17:9的全面屏设计,小米特意找谷歌沟通了大半年,说服谷歌取消安卓对于屏幕比例为16:9和4:3的限制。

而在打破了这一限制之后,手机行业在屏幕显示上也迎来了新一轮的创新性爆发。

VR180视频格式的180°,其实也是这样的一个牢笼。

而除了可以把VR180的FOV扩展为1到360°,它的投影方式也不必局限在「等距柱状投影」上。

同样以【V6】期的DIY举例,因为要转成「等距柱状投影」,所以我们需要要对图像进行展开。

而这种展开是没有意义的,因为在VR眼镜显示时它会无视这种变形。

但如果我们可以使用原始的鱼眼投影,那么真正的有效像素就只是2个4K视频而已,甚至还不到。

而这2种形式的图像在VR里观看时,是没有区别的。

反而因为多做了这一步投影转换,画质是有所损失的。

因此对于改良的「球面3D影像」来说,「等距柱状投影」是非必要的。

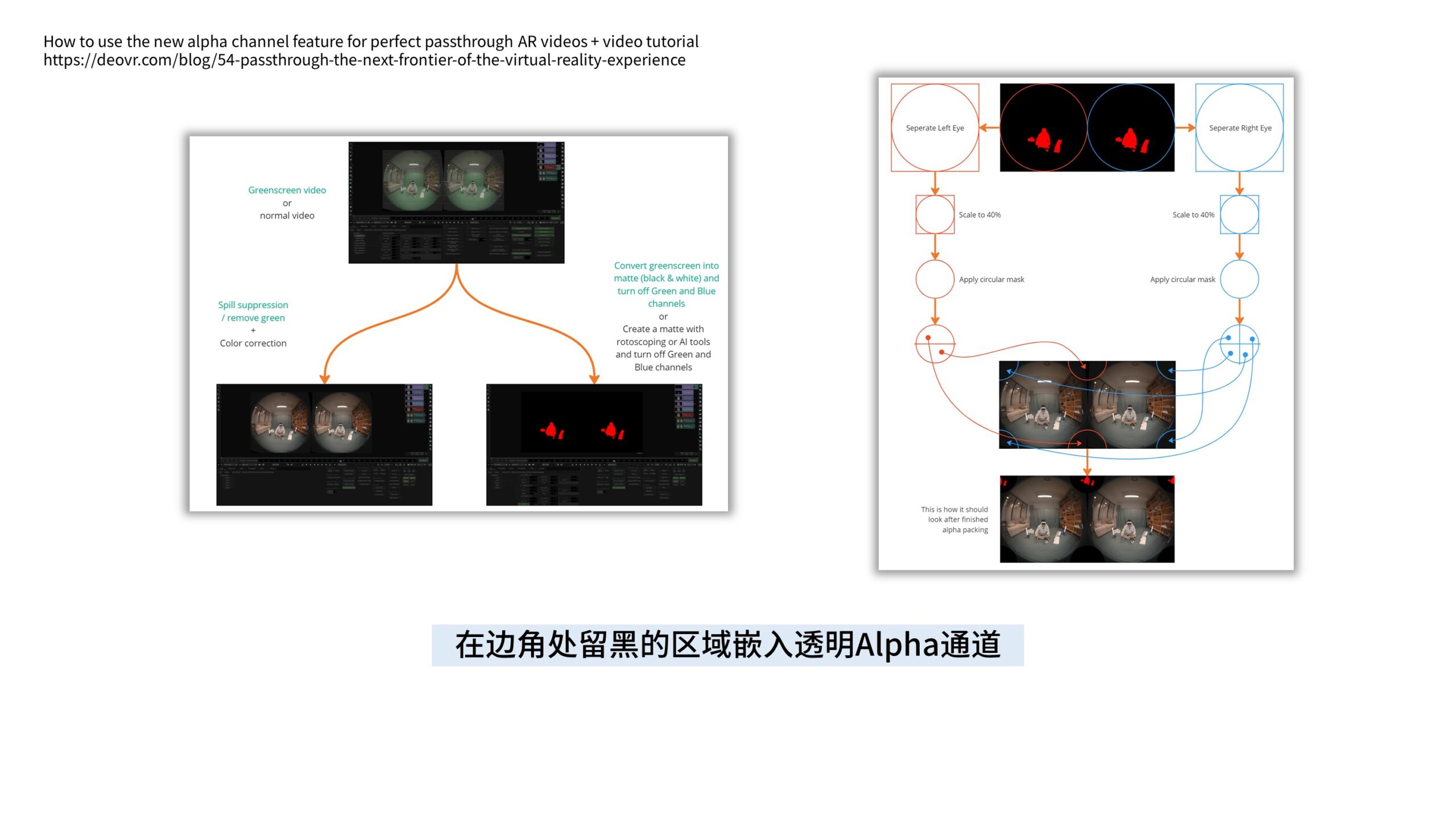

反而「等距鱼眼投影」就是很不错的选择,边角处留黑的区域也可以嵌入透明Alpha通道或者深度图,以实现更多的显示效果。

How to use the new alpha channel feature for perfect passthrough AR videos + video tutorial

https://deovr.com/blog/59-how-to-use-the-new-alpha-channel-feature-for-perfect-passthrough

并且也不一定就要是「等距鱼眼投影」,可以在视频文件内嵌入鱼眼系数或者传统的多阶镜头校正参数,VR眼镜在播放时依据参数对画面做调整。

很多事情不需要提前做,反而可以提升效率。

对于相机厂商来说,做一个能拍4K视频的相机,和做一个能拍8K视频的相机,两者的难度和成本是天壤之别的,更别说还要多做一步毫无意义的投影转换。

而对于用户来说,拍4K视频和拍8K视频的剪辑和存储压力,也是天壤之别。

对于流媒体的传输带宽和流量来说,也是如此。

如果不能解决当前VR180格式的低效问题,那么UGC的3D视频拍摄是很难推广起来的。

除此之外,相机的视差校准的数据也可以写入文件,交给播放器来做。

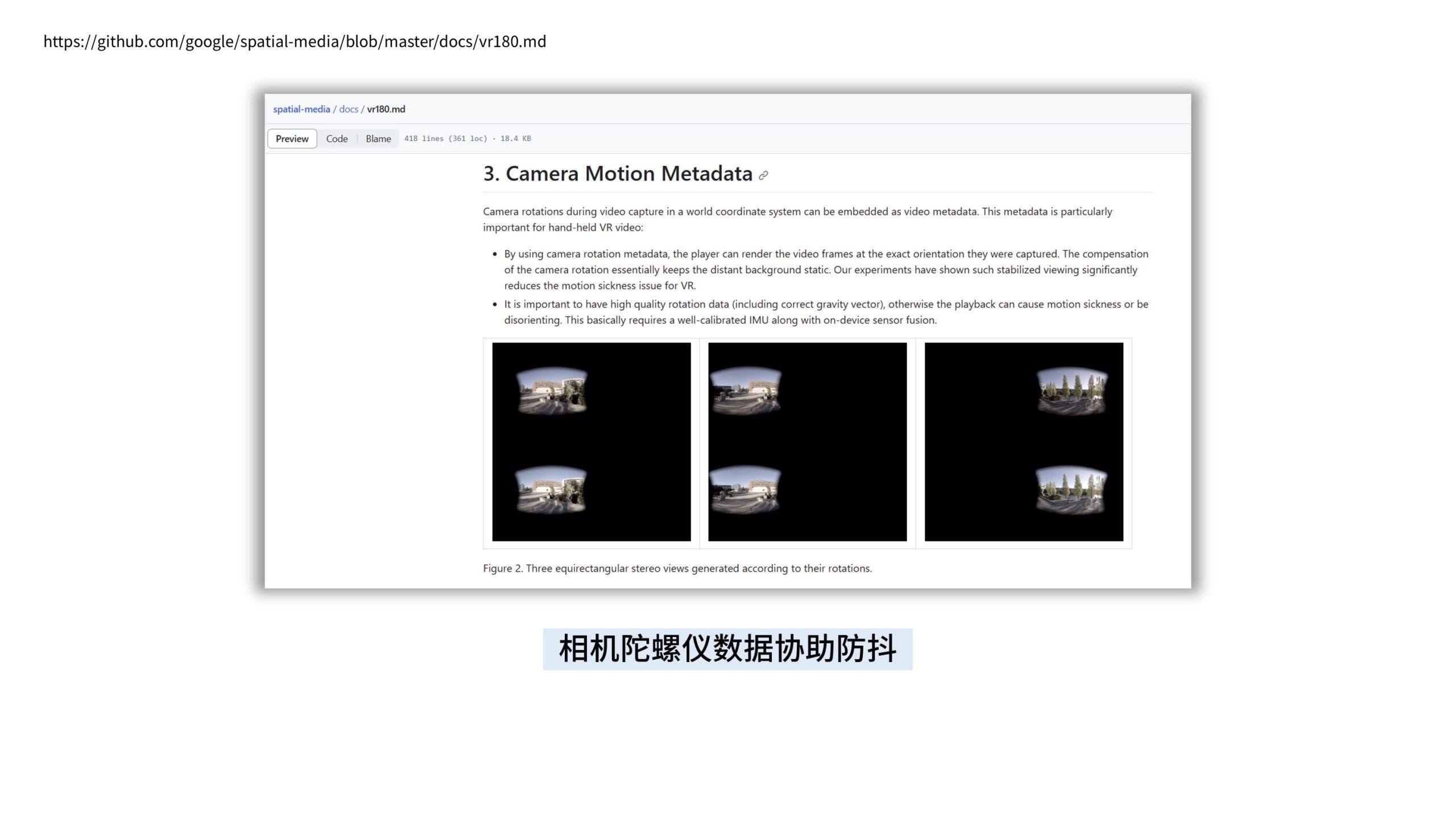

甚至也可以写入相机的陀螺仪数据,在后期进行一定程度的防抖。

谷歌当年在定义VR180这类「空间媒体」spatial-media的时候,就提出过类似的思路,我们至今还可以在Github上找到这些。

只是似乎并没有软件去真正实现它而已。

https://github.com/google/spatial-media/blob/master/docs/vr180.md

总而言之,VR180这个用了7年的视频格式,已经很好地完成了它最初的使命。

而现在我们需要一个全新的改良的「球面3D影像」格式,让它带领我们走向新世界。

E. 如何前往新世界

苹果新发布的iPhone 15 Pro可以拍摄「平面3D影像」,这是一件重要的事情。

但很多人没能客观地看待这个事情,一方面幻想着苹果有一些不存在的三体人科技,另一方面又忽视了它所作出的各种微小但真实的努力。

这个频道的「双目VR摄影」系列做了这么多期视频,我已经尽量讲得足够通俗易懂了,但在这个时间点似乎还是太早了。

有许多人还一直飘在天上,没有落地。

这个情况有点打击到我的创作热情。

那对于系统性原理的探索,就先告一段落吧。

后续的【V】系列,我会做一些更加简单有趣的内容。

我是HW君,我们下期再见。

(本章节完)

By HW君 @ 2023-09-25

【我破解了人眼立体视觉的算法原理(上)】 https://www.bilibili.com/video/BV1Wx4y1Y7Jk/?share_source=copy_web&vd_source=3c448aa40a016c8a992e2dfcb1884771

作者您好,你有空的时候,能不能分析一下这个UP的有关空间视觉原理视频?他研究发现,人眼的视轴与机器眼(相机)的视轴不一致,人眼视轴不与光轴重合的原因,还有球形视网膜与相机平面成像单元会出现的深度信息差异等等!

那么对于空间摄影,设置对称的双目相机,记录一个在1米远的苹果,是否其90度以内视野的空间深度坐标也不再与人眼一致了?

这位UP主的视频有很多主观臆测,我认为没有分析和讨论的必要。

感谢作者您的意见,这位UP确实有未经客观验证的个人推测,他所推测的观点与主流人眼模型观点不符,还有双眼辐辏现象也与主流观点不一致。

好高兴博主再次发布新作品,期待将来能发布更多的相关内容。

我想问一问作者您,如果VR180视频在记录影像阶段不可避免发生错误(作者之前的系列视频讲过的各种双目相机对位问题),是否可以开发一款可靠的三维影像AI校准软件? 比如,一些双目相机像“斗鸡眼”方式安装,虽然镜距也设置在60MM~65MM,但是最后记录的图像与相同设置的平行直视双目相机有天壤之别。

实际上Mistika就可以做到校正,只是校正的公式和参数比较复杂,但对这种非标相机的校正本身也没有很好的办法进行傻瓜化

十分感谢作者的回答,所以我可以理解为标准化双目相机才是根本后期由算法矫正是不切实际的吗?

作者,我还想多问一个问题,您之前的系列内容说过,180视频的水平方向超过90度的极右或极左会失去立体视差,因为双目相机是水平固定的。那么,在纵轴超过90度的极下和极上的方向,双目相机始终保持同样的摄距,它们是否有立体信息错误呢?

(1)要从硬件上就标准化,而不是一切都依靠软件后期校正。

(2)只要硬件拍摄和软件校正都是正确的,那么纵轴的方向上就不会有错误。

我似乎来晚了,但是还是很感谢博主的讲解和分享